Virtuelle Realität zum Anfassen

Forscher am Institut für Bildverarbeitung der ETH Zürich haben eine Methode entwickelt, mit der sie virtuelle Kopien von realen Objekten erzeugen. Die Kopien kann man berühren und sogar über das Internet verschicken. Indem der Tastsinn mit einbezogen wird, kann der Benutzer tiefer in die virtuelle Realität eintauchen.

Einem Freund ein virtuelles Geburtstagsgeschenk schicken oder dem Kunden in Amerika schnell das neue Produkt zum Ausprobieren rüber beamen – was nach Science Fiction klingt, wollen Forscher am Institut für Bildverarbeitung mit Hilfe einer neuen Technologie möglich machen. In einem ersten Schritt gelang es ihnen jetzt, ein virtuelles Objekt an eine räumlich entfernte Person zu übermitteln, die das Objekt nicht nur sehen, sondern auch betasten und bewegen konnte.

Alle Sinne einbeziehen

Der Immersionsgrad, also das Eintauchen in die virtuelle Realität, ist umso stärker, je mehr Sinne angesprochen werden. Während in den letzten Jahren die bildliche und akustische Simulation von virtueller Realität immer realistischer wurde, hinkt die Entwicklung im Bereich der Haptik, also des Tastsinns, weit hinterher. Bisher war es nicht möglich, das virtuelle Abbild eines Objekts anzufassen oder zu bewegen. Das Ziel des EU-Projekts «Immersence», an dem sich auch die ETH Zürich beteiligte, war die Entwicklung neuer Methoden zur haptischen Interaktion. Matthias Harders leitete zusammen mit weiteren Wissenschaftlern vom Institut für Bildverarbeitung das Teilprojekt, das sich mit der Interaktion von Personen mit virtuellen Objekten beschäftigte.

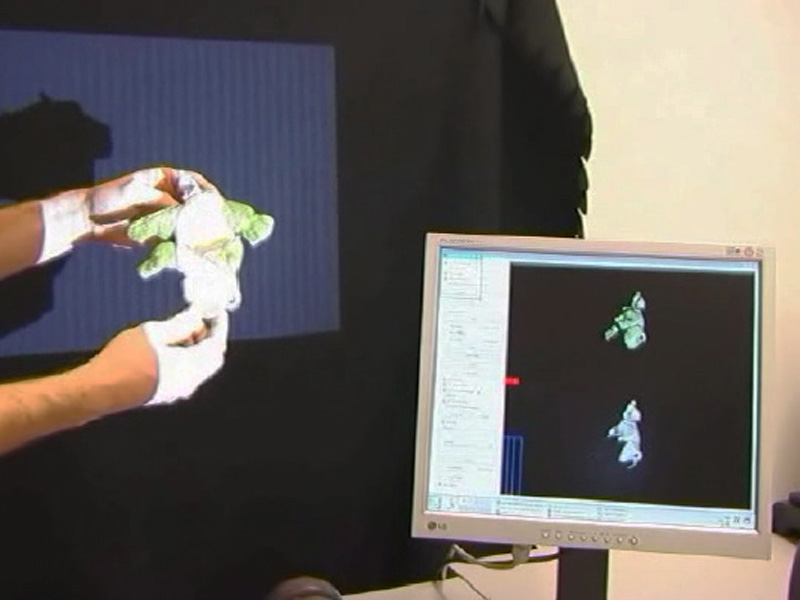

Die Forscher entwickelten eine Methode, um visuelle und haptische Eindrücke miteinander zu kombinieren. Während ein 3D-Scanner ein Bild des Objekts – in einem Versuch ein Spielzeugfrosch aus Plüsch – aufnimmt, tastet ein Benutzer das Objekt gleichzeitig mit einem haptischen Gerät ab. Der in alle Richtungen bewegliche Tastarm, ausgestattet mit Druck- und Rutschsensoren, sammelt dabei Informationen über Form und Festigkeit. Mit Hilfe eines Algorithmus wird aus den Messungen am Computer ein virtuelles Ebenbild erzeugt - noch während der Plüschfrosch gescannt und abgetastet wird.

Sehen und Fühlen kombinieren

Die virtuelle Kopie kann beliebig per Internet an eine andere Person verschickt werden. Damit diese den virtuellen Frosch sehen und fühlen kann, braucht sie eine spezielle Ausrüstung: eine Datenbrille mit Monitor, auf den das virtuelle Objekt projiziert wird, und einen Taststab, der mit kleinen Motoren ausgestattet ist. Ein Computerprogramm berechnet, wann sich virtuelles Objekt und Taststab treffen und gibt dann ein Signal an die Motoren des Stabs. Diese bremsen die vom Benutzer ausgeführte Bewegung ab und simulieren dadurch einen Widerstand. Der Benutzer hat das Gefühl, den Frosch zu berühren, während er - von aussen betrachtet - in der Luft stochert.

Um den Eindruck von Realität noch zu verstärken, kann der virtuelle Frosch in die tatsächliche Umgebung projiziert werden und scheint dann zum Beispiel auf dem Tisch vor dem Betrachter zu sitzen. Die Überlagerung von realer und virtueller Welt, die als «augmented reality», also erweiterte Realität, bezeichnet wird, haben die Forscher bereits in einem vorherigen Projekt realisiert. Dabei entwickelten sie ein Pingpong-Spiel, bei dem nur der Griff des Schlägers tatsächlich existiert. Mit einer virtuellen Schlagfläche können sich zwei Spieler den virtuellen Ball gegenseitig zuspielen. «Das fühlt sich schon ziemlich ähnlich an wie bei einem richtigen Spiel», sagt Matthias Harders.

Technologie der Zukunft

Während frühere Ansätze das virtuelle Objekt grösstenteils anhand von Annahmen simulierten, stützt sich die Methode der ETH-Forscher stärker auf gemessene Daten. «Unser Ansatz lässt sich als eine Erweiterung der Fotografie betrachten», erläutert Harders. Die Methode ist besonders dann von Vorteil, wenn es sich um komplexe Objekte handelt, die mit einem Modell nur sehr schwer zu beschreiben wären.

Bisher ist es zwar möglich, ein virtuelles Objekt zu berühren, nicht aber es zu ergreifen. Dafür werden spezielle Sensorhandschuhe benötigt, mit denen der Benutzer sowohl ein reales Objekt «einscannen» als auch ein virtuelles Objekt betasten kann. An deren Entwicklung arbeiten die ETH-Forscher noch. Doch Harders glaubt, dass diese Technologie in zwanzig Jahren schon so gebräuchlich sein könnte wie heute das Internet.

Mit dem Teleporter an die Konferenz

In ihrem nächsten EU-Projekt, dessen Name «Beaming» an Raumschiff Enterprise erinnert, gehen die Wissenschaftler noch einen Schritt weiter. Sie planen eine Methode zum Teleportieren, also zum Versenden von Personen. «Natürlich nur virtuell», versichert Harders. Damit würde zum Beispiel die Teilnahme an einer Konferenz möglich, ohne persönlich anwesend sein zu müssen. Das würde Zeit und Reisekosten sparen. Gleichzeitig wäre die Interaktion mit anderen Teilnehmern intensiver, als das zum Beispiel bei Videokonferenzen möglich ist. «Die Idee ist, das Gefühl zu erzeugen, man sässe zusammen an einem Tisch».

LESERKOMMENTARE